La agencia de noticias EFE cuestionó a Grok, el asistente de inteligencia artificial de X, tras clasificar como falso un video sobre un ataque en Irán.

El material, que mostraba un bombardeo a una escuela de mujeres en Minab, fue inicialmente desestimado por la IA como imágenes de Kabul en 2021.

Aunque Grok corrigió su error “horas después”, EFE denunció que la rectificación tuvo menor alcance y advirtió que los fallos algorítmicos ponen en riesgo la credibilidad del periodismo profesional.

EFE se lanza contra Grok por clasificar como falso un video de ataque en Irán

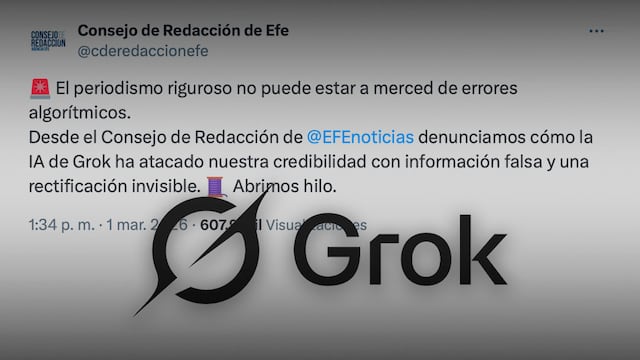

El Consejo de Redacción de EFE se lanzó contra Grok luego de que la herramienta de IA de X clasificara como falso un video de los ataques en Irán, señalando que esto representa un ataque a su credibilidad con información falsa y carente de rectificación.

Ante este tipo de acciones, EFE manifestó que el periodismo no puede depender de errores algorítmicos, pues pone en entredicho la credibilidad de medios profesionales en contextos de alta sensibilidad internacional.

Horas después, Grok corrigió su evaluación inicial y admitió un error. Sin embargo, EFE reprochó que la propia rectificación tuvo un menor alcance que el mensaje original.

EFE manifestó que el material que presentaron sobre el ataque a una institución educativa fue proporcionado por las agencias iraníes Tanim y Mehr.

Además, dijo hubo un proceso de geolocalización con Google Maps para contrastar puntos visibles en las imágenes con registros satelitales, confirmando así coincidencias entre edificios, calles y estructuras.

El diario español hizo mención a otros medios como RTVE y Antena 3, los cuales señaló también se vieron afectados por una IA al difundir material relacionado con los bombardeos a Irán.

EFE subrayó que el error humano es posible, pero reiteró que su trabajo se basa en la ética y el contraste de fuentes previo a desvelar una información importante.